——我国学者与海外合作者在大语言模型无损知识编辑研究方面取得进展

打印

打印

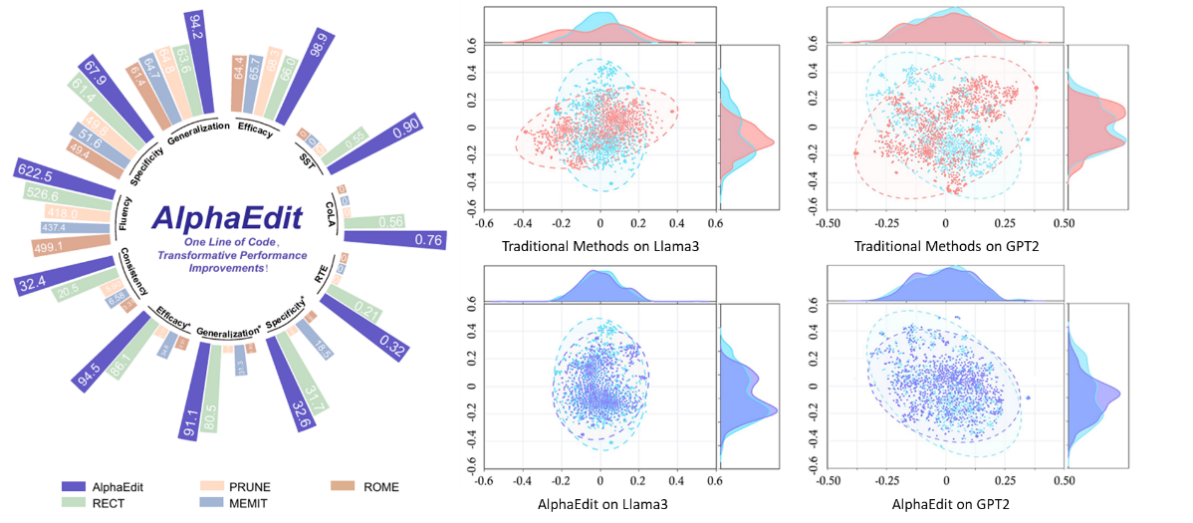

图 左:实验效果对比图。AlphaEdit仅需一行代码即可实现大语言模型的无损知识更新,更新效果超过现有方法。右:模型内部表征分布图。AlphaEdit的更新对模型内部表征的干扰最小,实现了更可控、更安全的知识更新

在国家自然科学基金项目(批准号:92270114)等资助下,中国科学技术大学王翔教授、何向南教授联合新加坡国立大学团队,提出面向大语言模型的无损知识编辑方法,通过引入零空间约束机制,仅需一行代码即可实现目标知识的高效更新,同时保持模型原有知识体系的完整性。研究成果以“AlphaEdit: Null-Space Constrained Knowledge Editing for Language Models”为题,于2025年4月29日在线发表于人工智能领域国际顶级学术会议“国际表征学习会议”(International Conference on Learning Representations, ICLR),并被评选为“杰出论文奖”(Outstanding Paper;从11672篇投稿中评选出3篇)。论文链接:https://openreview.net/forum?id=HvSytvg3Jh。

近年来,大语言模型在自然语言处理以及生物医药、化学等交叉学科领域中展现出卓越的知识表达与推理能力,推动了多个学科的智能化进程。然而,现有针对大语言模型的知识编辑方法在引入新增、修正错误或淘汰过时知识的过程中,常伴随对模型中原有正确知识的破坏。这一问题在知识快速更新的生物医学、化学等领域,以及对模型稳定性要求较高的端侧部署场景中尤为突出,制约了大语言模型的部署应用,甚至可能引发系统性风险。

为此,研究团队提出了一种基于零空间投影机制的大语言模型知识更新方法AlphaEdit,在理论与实践层面实现了对原有知识“零干扰”的无损更新。AlphaEdit通过构建目标知识变动在参数空间的零干扰方向,实现了无需重新训练、无破坏地更新模型知识,突破了现有方法在编辑精度、效率与知识保持性方面的瓶颈。该方法仅需一行代码即可实现高效更新,在显著降低计算成本的同时,缓解了知识遗忘问题,保障了模型知识体系的完整性与稳定性。

在LLaMA3、GPT2-XL、GPT-J等主流大语言模型上的系统性评估表明,AlphaEdit相较传统方法在知识更新效果上相对提升最高达36.7%。其轻量化、高保真、高效率的特性为模型部署与维护提供了全新思路,尤其适用于高频更新与资源受限的端侧场景。

该工作为构建更可控、更安全、更高效的大语言模型提供了支撑,有望加速大模型技术在科研、医疗、药物设计等实际场景中的落地应用。